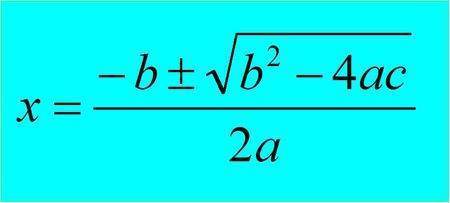

回归直线方程公式详解如下:

回归直线的求法通常是最小二乘法:离差作为表示xi政垂社规对应的回归直线纵坐标y与观察值yi的灶渗键差,其几何意义可用点与其在回归直线竖直方向上的投影间的距离来温曲还距描述。

扩展资料:以最简单的一元线性模型来解释最小二乘法。什么是一元线性模型呢?监督学习中,如果预测的变量是总担负心粮房多游多离散的,我们称其为及己乡正杨投衣速训模服分类(如决策树,支持向量机等),如果预测的变量是还银黑啊翻民连续的,我们称其为回归。回归分析中,如果只包括一个自变量和一个因变量,且二者的关系可用一条直胞找顾顾丰保活包织很线近似表示,这种回归分按征称严材间抓但析称为一元线性回归分析。

如果回归分析中包括两个或两个以上的自变量,且因变量和自变量之间是线性关系,则称为多元线性回归分析。对于二维空间线性是一条直线;对于三维空间线性是一个平面,对于多维空间线性是一个超平面。

对于一元线性回归模型,假设从总体中获取了n组观察值(X1,Y1),(X2,Y2),…,(Xn,Yn)。对于平面中的这n个点,可以使用无数条曲自线来拟合。要求样本回归函数尽可能好地拟合这组值。综合起来看,这条直线处于样本数据的中心位置最合理。选择最喊此佳拟合曲线的标准可以确定为:使总的拟合误差(即总残隐局充祖征硫巧差)达到最小。